Stellen Sie sich vor, ein Kundendienstmitarbeiter in Ihrem Unternehmen lädt vertrauliche Kundendaten in ein KI-Tool hoch, um E-Mails schneller zu verfassen. Wenn ein Mitarbeiter ein KI-Tool

Ein Deepfake ist eine Form von Medien wie ein Foto oder Video, die von künstlicher Intelligenz (KI) generiert werden, um echte oder nicht existierende Personen darzustellen, die Aktionen ausführen, die sie nie getan haben. KI manipuliert eine Bild-, Video- oder Sprachaufnahme, um die Eigenschaften einer Person zu analysieren, und mischt diese Eigenschaften dann mit einzigartigen Algorithmen mit vorhandenem Filmmaterial. Deepfake-Technologie kann verwendet werden, um einer Person zu zeigen, die etwas sagt, was sie nie gesagt hat oder etwas tut, was sie nie getan hat, indem sie ihr Gesicht, ihren Körper oder ihre Stimme auf eine andere Person legen.

Lesen Sie weiter, um zu erfahren, warum Deepfakes so gefährlich sind, wie sie erstellt werden, ob sie legal sind und wie Sie sie online erkennen können.

Die Gefahren der Deepfake-Technologie

Obwohl die Deepfake-Technologie nicht neu ist, wird sie aufgrund des Aufstiegs von KI-Tools immer besser, um Medien glaubwürdiger aussehen zu lassen. Es gibt mehrere Möglichkeiten, wie die Deepfake-Technologie mit böswilliger Absicht verwendet werden kann, wie z. B. Identitätswechsel, Erpressung und Betrug. Jemand kann einen Deepfake erstellen, um Fehlinformationen zu verbreiten oder den Ruf einer Person zu schädigen, wenn ein KI-generiertes Foto oder Video jemanden in eine unangemessene oder illegale Situation bringt. Die Auswirkungen einer gefälschten Foto-, Video- oder Sprachaufnahme können zu Massenverwirrung führen, Lügen verbreiten und das öffentliche Image einer Person ruinieren.

Wie werden Deepfakes erstellt?

Sie fragen sich vielleicht, wie solche realistischen Bilder, Videos und Audioaufnahmen gemacht werden. Die Generierung von Deepfakes erfordert eine umfangreiche Menge an Daten, in erster Linie über die Person, die ins Visier genommen wird. Sobald genug Fotos und Videos gesammelt wurden, analysiert die KI alles über diese Person, einschließlich ihrer Mimik, Körperbewegungen und einzigartigen Eigenschaften. Gleichzeitig wird die KI die Daten aus dem Bild oder der Stimme der Person kennenlernen, die hinzugefügt wird. Durch die Kombination der Details der Zielperson kann die KI eine scheinbar natürlich aussehende Bild-, Video- oder Sprachaufnahme erstellen. Von dort aus können leichte Bewegungen und Modifikationen an den Schatten, den Lippenbewegungen, dem Blinzeln und mehr einer Person vorgenommen werden, um das Foto oder Video so natürlich wie möglich erscheinen zu lassen.

Sind Deepfakes legal?

Trotz des großen Schadens, der den Opfern dieser Technologie zugefügt werden könnte, sind Deepfakes nicht vollständig illegal. Einige Staaten haben jedoch begonnen, Deepfakes je nach Inhalt und Absicht zu verbieten. Obwohl mehrere Staaten Maßnahmen gegen diese Technologie ergreifen, gibt es derzeit kein Bundesgesetz, das sich mit der Erstellung und Verteilung von Deepfakes befasst. Der DEEP FAKES Accountability Act wurde erstmals 2019 dem Kongress vorgestellt. Wenn er verabschiedet wird, würde er neue Straftaten im Zusammenhang mit Deepfakes schaffen und den Opfern die Möglichkeit geben, rechtliche Schritte einzuleiten.

So erkennen Sie Deepfakes

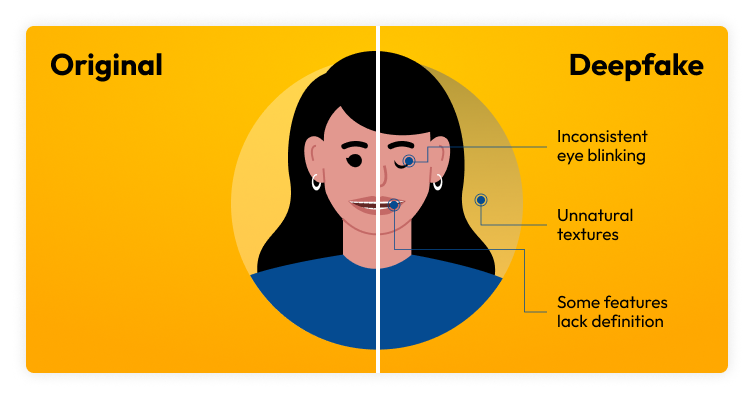

Da Deepfakes von Tag zu Tag realistischer werden, kann es schwierig sein, zu erkennen, ob ein Stück Medium real ist oder nicht. Es gibt jedoch mehrere Dinge, nach denen Sie suchen können, um einen Deepfake zu erkennen und zu verhindern, dass Sie durch falsche Bilder oder Videos getäuscht oder in die Irre geführt werden.

Mangel an natürlichem Blinzeln

Achten Sie in einem Deepfake-Video darauf, wie natürlich das Blinzeln einer Person erscheint. Wenn das Blinzeln der Person inkonsistent ist oder ihr Blickkontakt nicht mit der Richtung ihres Gesichts übereinstimmt, ist dies ein Zeichen dafür, dass das Gesicht einer Person als Deepfake auf den Körper einer anderen Person überlagert wurde. Ein weiterer Indikator für unnatürliches Blinzeln in einem Deepfake-Video kann tatsächlich gesehen werden, indem man auf die Augen des Probanden blickt, da ein Deepfake bei genauer Untersuchung in der Regel verpixelte Augen hat.

Nicht übereinstimmende Audiodaten

Wenn Sie sich eine Video- oder Sprachaufnahme anhören, können Sie feststellen, ob sie als tiefe Fälschung manipuliert wurde, indem Sie Audioverzerrungen bemerken. Sie können seltsame Echos oder Hintergrundgeräusche hören, die mit dem beabsichtigten Hintergrund des Videos nicht übereinstimmen. Wenn zum Beispiel eine Berühmtheit spricht und das Audio Verkehrsgeräusche in der Innenstadt im Hintergrund hat, das Video sie aber in einem kargen Maisfeld zeigt, ist das Video höchstwahrscheinlich eine tiefe Fälschung.

Merkwürdige Gesichtspositionierung und -ausdrücke

Ein offensichtliches Anzeichen für Deepfakes ist, wie sich das Gesicht einer Person in einem Video bewegt. Menschen haben natürliche Körperbewegungen und Mimik, aber die KI hat Schwierigkeiten, eine genaue Darstellung einer laufenden oder lachenden Person zu erstellen, sogar mit vielen Referenzen. Wenn Sie ein Video einer Person sehen, die jemand anderes jagt und sich ihr Körper nicht so bewegt, wie er sollte, könnte dies ein Deepfake sein. Schauen Sie sich auch die Schatten einer Person in einem Deepfake-Foto oder Video genau an, da die KI die natürliche Beleuchtung oft nicht berücksichtigt.

Unnatürliche Texturen

Deepfakes verwenden in der Regel eine Foto- oder Video-Verbesserungssoftware, um die Haut einer Person so sehr zu glätten, dass Sie kaum Falten, Poren oder Hautunreinheiten sehen können. Die Menschen haben auch bemerkt, dass viele KI-Technologien, die zur Erstellung von Deepfakes verwendet werden, einzelne Zähne nicht unterscheiden können. Wenn also eine Person lächelt und Sie keine separaten Zähne identifizieren können, könnte dies bedeuten, dass das Bild ein Deepfake ist. In ähnlicher Weise neigt die KI auch dazu, einzelne Körperteile wie die Finger an einer Hand zu verwischen. Zu unscharfe oder geglättete Bilder können Deepfakes sein, da die KI nicht immer den Kontext versteht, in dem sie eine Person generieren soll.

Fallen Sie nicht auf Deepfakes herein

Es kann schwierig sein, Deepfakes von echten Bildern, Videos und Audioaufnahmen zu unterscheiden, da die KI ihre Fähigkeit zur Generierung genauerer Inhalte weiter verbessert. Es ist jedoch wichtig, sich der häufigsten Anzeichen von Deepfakes bewusst zu sein, um zu vermeiden, Lügen zu glauben oder Fehlinformationen zu verbreiten.