Imagine que un representante de servicio al cliente de su organización cargue datos confidenciales de clientes en una herramienta de IA para redactar correos electrónicos más

Las falsificaciones profundas son un tipo de multimedia, como una foto o un vídeo, generado por IA, que representa a personas reales o que no existen llevando a cabo acciones que nunca realizaron. Mediante la IA se manipula una fotografía, un vídeo o una grabación de voz para analizar las características de una persona y luego las combina con el material existente mediante algoritmos únicos. Las tecnologías de falsificación profunda se pueden utilizar para mostrar a una persona diciendo algo que nunca dijo o bien haciendo algo que nunca ha hecho, superponiendo su cara, cuerpo o voz sobre los de otra persona.

Siga leyendo para saber por qué los deepfakes son tan peligrosos, cómo se crean, si son legales y cómo detectarlos en línea.

Los peligros de la tecnología deepfake

Aunque la tecnología deepfake no es nueva, cada vez es más eficaz a la hora de hacer que los medios se vean más creíbles gracias al auge de las herramientas de IA. Hay varias maneras en que la tecnología deepfake se puede utilizar con intenciones maliciosas, como la suplantación de identidad, el chantaje o el fraude. Cualquiera puede crear un deepfake con el que difundir información falsa o dañar la reputación de otros a través de una foto o un vídeo generados por IA que coloque a alguien en una situación inapropiada o ilegal. Las implicaciones de una foto, un vídeo o una grabación de voz falsas pueden provocar confusión, ayudar a difundir mentiras y arruinar la imagen pública de una persona.

¿Cómo se generan las falsificaciones profundas?

Tal vez se pregunte cómo se genera este tipo de imágenes, vídeos y grabaciones de audio realistas. La generación de deepfakes requiere una gran cantidad de datos, principalmente sobre la persona objeto del ataque. Una vez se han recopilado suficientes fotos y videos, la IA analiza todo lo relacionado con esa persona, incluidas sus expresiones faciales, movimientos corporales y características únicas. Al mismo tiempo, la IA se familiarizará con los datos de la imagen o la voz de la persona que están siendo agregados. Al combinar los detalles de la persona objetivo, la IA puede crear una grabación de imagen, vídeo o voz de aspecto natural. A partir de ahí, se pueden hacer pequeños movimientos y modificaciones en las sombras, los movimientos de los labios, los parpadeos y mucho más para que la foto o el vídeo se vean lo más naturales posible.

¿Son legales las falsificaciones profundas?

A pesar del enorme daño que podrían causar a las víctimas de esta tecnología, las falsificaciones profundas no son del todo ilegales. Sin embargo, algunos estados han comenzado a prohibir los deepfakes en función de su contenido e intención. Aunque varios estados están en proceso de tomar medidas contra esta tecnología, actualmente no existe una ley federal que aborde la creación y distribución de deepfakes. La Ley de responsabilidad en materia de DEEP FAKES fue presentada por primera vez en el Congreso en 2019; si se aprueba, se crearán nuevos delitos relacionados con los deepfakes y se proporcionará a las víctimas la posibilidad de emprender acciones legales.

Cómo detectar las falsificaciones profundas

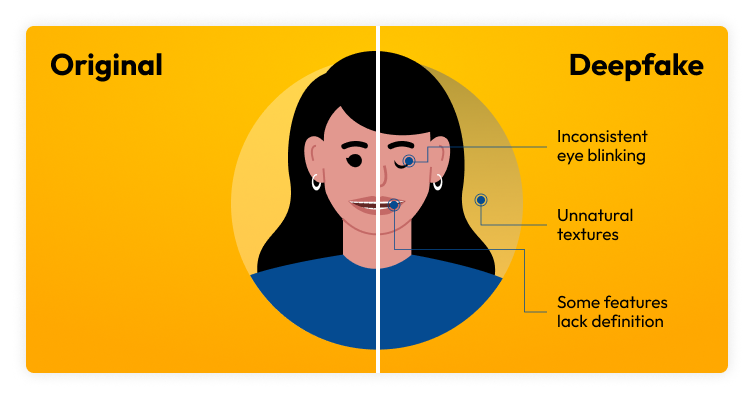

Dado que las falsificaciones profundas son cada vez más realistas, puede resultar difícil detectar cuando un medio es real o no. Sin embargo, hay varias cosas en las que puede fijarse para detectar una falsificación profunda y evitar ser engañado por una imagen o un vídeo falso.

Ausencia de parpadeo natural

En los vídeos deepfake, preste mucha atención a la naturalidad con que parpadean las personas. Si el parpadeo de la persona es inconsistente o su mirada no está orientada en la misma dirección que el rostro, se trata de una señal de que la cara podría haber sido superpuesta sobre el cuerpo de otra persona en forma de falsificación profunda. Otro de los indicadores de un parpadeo antinatural en los vídeos de falsificación profunda puede observarse en los ojos del sujeto, puesto que los de las falsificaciones profundas suelen tener los ojos pixelados cuando son examinados de cerca.

El audio no coincide

Cuando escuche un vídeo o una grabación de voz, podrá saber si ha sido manipulado a través de una falsificación profunda observando las distorsiones de audio. Es posible que escuche ecos extraños o ruidos de fondo que no coincidan con el fondo previsto del vídeo. Por ejemplo, si un famoso está hablando y en el audio se escuchan ruidos de tráfico de fondo, pero el vídeo lo muestra frente a un campo de maíz baldío, lo más probable es que se trate de una falsificación profunda.

Posiciones y expresiones faciales extrañas

Un signo evidente de las falsificaciones profundas es la forma en que se mueve el rostro de la persona en el vídeo. Los seres humanos tienen una forma natural de mover el cuerpo y expresar sus emociones, pero a la IA le cuesta generar una representación precisa de una persona corriendo o riendo, por muchas referencias que tenga. Si ve un vídeo de una persona que persigue a otra y su cuerpo no se mueve de manera natural, es probable que se trate de una falsificación profunda. Además, no deje de fijarse en el aspecto de las sombras de la gente en los vídeos o fotos de las falsificaciones profundas, puesto que la IA no suele tener en cuenta la luz natural.

Texturas antinaturales

Las falsificaciones profundas suelen utilizar software de mejora de fotos o vídeos para suavizar la piel de la gente, hasta el extremo de que apenas se vean arrugas, poros o manchas. La gente también ha observado que muchas tecnologías de IA utilizadas para crear deepfakes no pueden distinguir los dientes individuales, por lo que si una persona sonríe y no la separación de los dientes no está clara, esto podría significar que se trata de una falsificación profunda. Del mismo modo, la IA también tiende a difuminar ciertas partes del cuerpo, como los dedos de las manos. Las imágenes demasiado borrosas o suavizadas podrían ser falsificaciones profundas, pues la IA no siempre comprende el contexto en el que se supone que debe generar a las personas.

No se deje engañar por las falsificaciones profundas

Las falsificaciones profundas pueden llegar a ser extremadamente difíciles de distinguir de las imágenes, vídeos y grabaciones de audio reales, ya que la IA no deja de mejorar su capacidad para generar contenidos cada vez más precisos. Sin embargo, es importante estar al tanto de los indicadores habituales de las falsificaciones profundas para evitar acabar creyendo en mentiras o dejarse engañar por informaciones falsas.