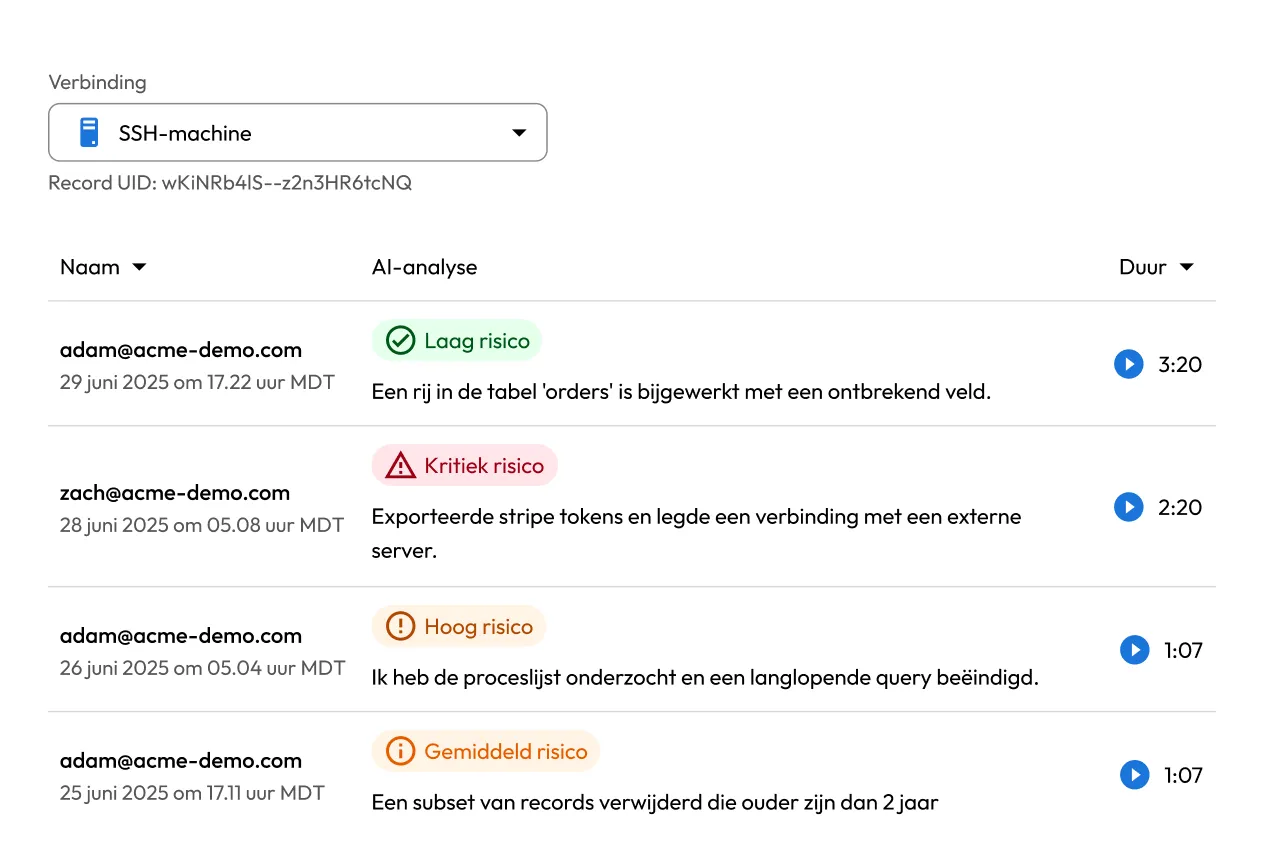

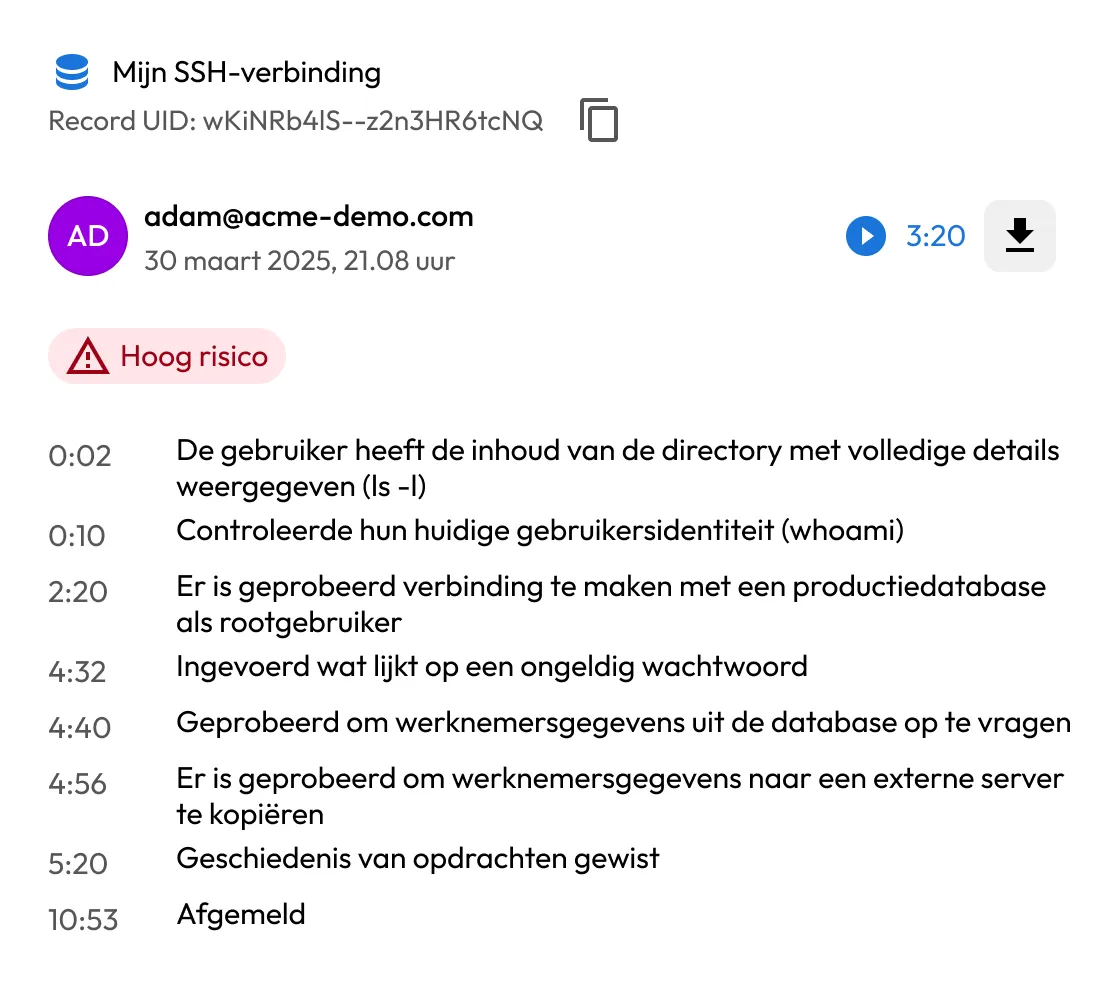

Realtime analyse van AI-bedreigingen

Analyseert automatisch live sessieactiviteit en categoriseert gedrag in kritieke, hoge, gemiddelde en lage risiconiveaus. Elke bedreiging wordt uitgelegd met gedetailleerde context per opdracht, zodat beveiligingsteams begrijpen waarom een actie riskant is, en niet alleen dat deze heeft plaatsgevonden.

Geautomatiseerde beëindiging van de sessie

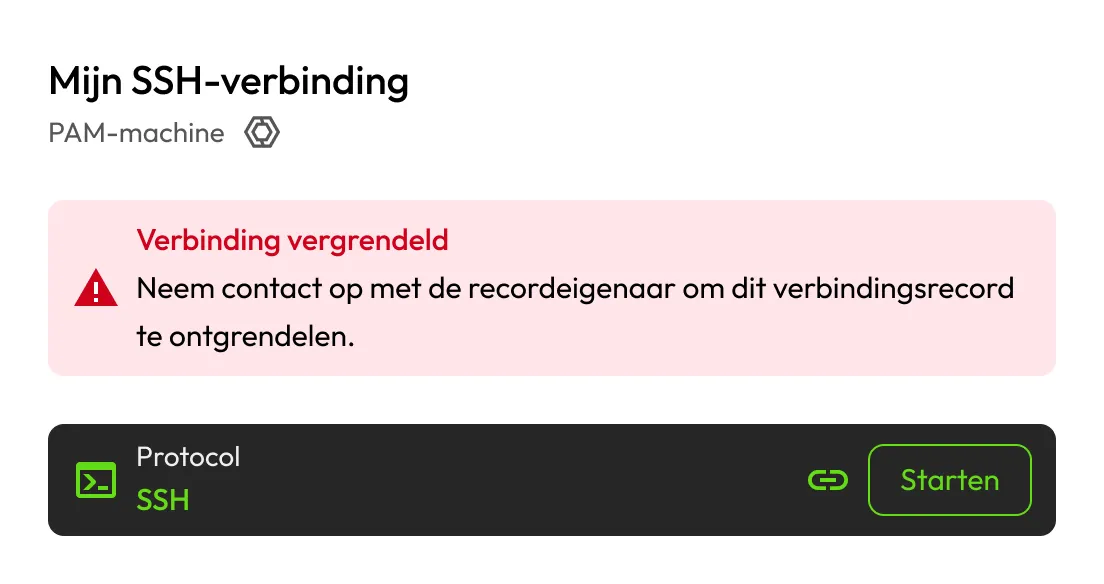

KeeperAI kan sessies onmiddellijk beëindigen wanneer kritisch of risicovol gedrag wordt gedetecteerd, waardoor de reactietijd en blootstellingsvensters drastisch worden verkort.

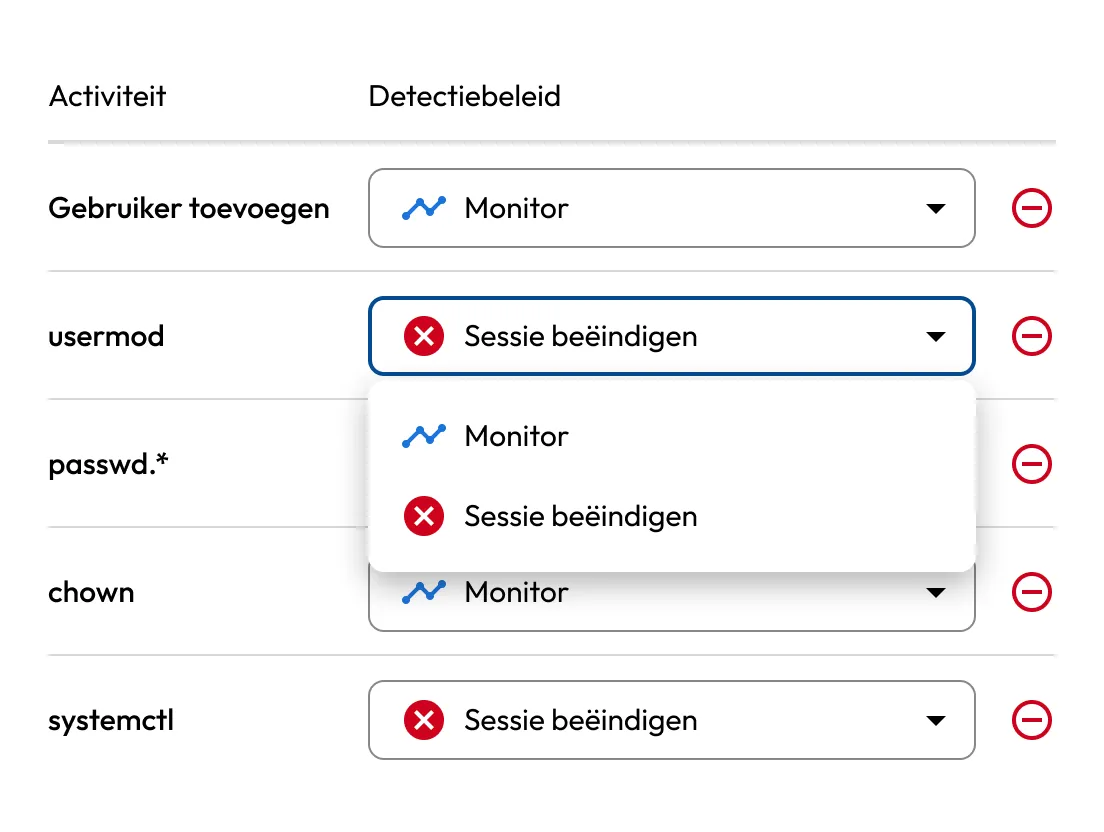

Patroonherkenning en aangepaste regels

Definieer uw eigen risico-indicatoren met aangepaste tekenreeks- of regex-patroonherkenning. Voorkom activiteit met "Sessie beëindigen"-acties of sta activiteit toe met "Alleen bewaken"-acties, afhankelijk van de behoeften van uw omgeving.

Flexibele LLM-integraties

Kies de Large Language Model (LLM) van uw voorkeur. KeeperAI integreert met alle LLM-providers die OpenAI-compatibele eindpunten ondersteunen, waaronder AWS Bedrock, Azure, Google Vertex AI, Grok en zelfgehoste runtimes.

Gestructureerde risicosamenvattingen

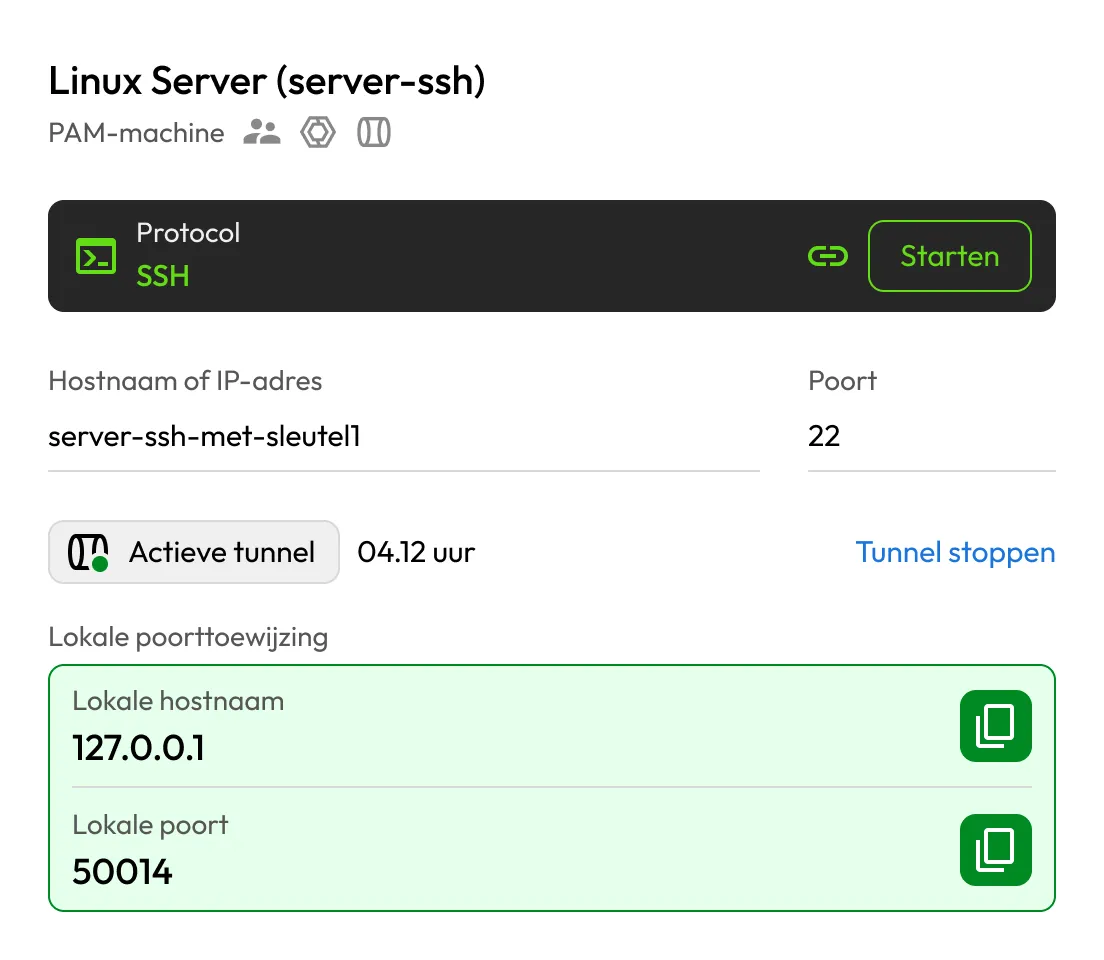

Genereer versleutelde samenvattingen van activiteiten met videoweergave van de sessie. Deze op AI gebaseerde samenvattingen bieden nauwkeurige forensische details voor audits en incidentrespons.

AI-gestuurde bevoorrechte sessiebewaking

KeeperAI analyseert bevoorrechte sessies in realtime om risico's te classificeren, reacties te automatiseren en versleutelde forensische samenvattingen te genereren in tekstgebaseerde en visuele omgevingen.